Facebook y Twitter se preparan para muchos de los peores escenarios del día de las elecciones de 2020

En la víspera de las elecciones estadounidenses de 2020, las tensiones aumentan.

¿Las buenas noticias? 2020 no es 2016. Las redes sociales están mucho mejor preparadas para manejar una amplia gama de escenarios complejos, peligrosos o ambiguos del día de las elecciones.

La mala noticia: 2020 es su propia bestia, que ha desatado un escenario de salud de pesadilla en una nación dividida que ahora es aún más susceptible a la desinformación, el hiperpartidismo y las ideas peligrosas que se mueven de la periferia al centro que hace cuatro años.

Estados Unidos fue tomado por sorpresa por la interferencia extranjera en las elecciones de 2016, pero sorprender a una nación que ha pasado los últimos ocho meses esperando una convergencia de los peores escenarios no será tan fácil.

Las plataformas sociales se han preparado para las elecciones de 2020 de una manera que no lo hicieron en 2016. Esto es lo que les preocupa y las lecciones críticas de los últimos cuatro años que aportarán.

Resultados electorales controvertidos

El presidente Trump ha señalado repetidamente que no aceptará los resultados de las elecciones en caso de que pierda, una amenaza impactante que podría poner en peligro la democracia estadounidense, pero una plataforma social ha estado siguiendo de cerca. El comportamiento errático y, a menudo, de inflexión de reglas de Trump en las redes sociales en los últimos meses ha servido como una especie de prueba de estrés, lo que ha permitido que esas plataformas jueguen en diferentes escenarios para las elecciones.

Facebook y Twitter, en particular, han presentado planes detallados sobre lo que sucede si los resultados de las elecciones no son claros de inmediato o si un candidato se niega a aceptar los resultados oficiales una vez contabilizados.

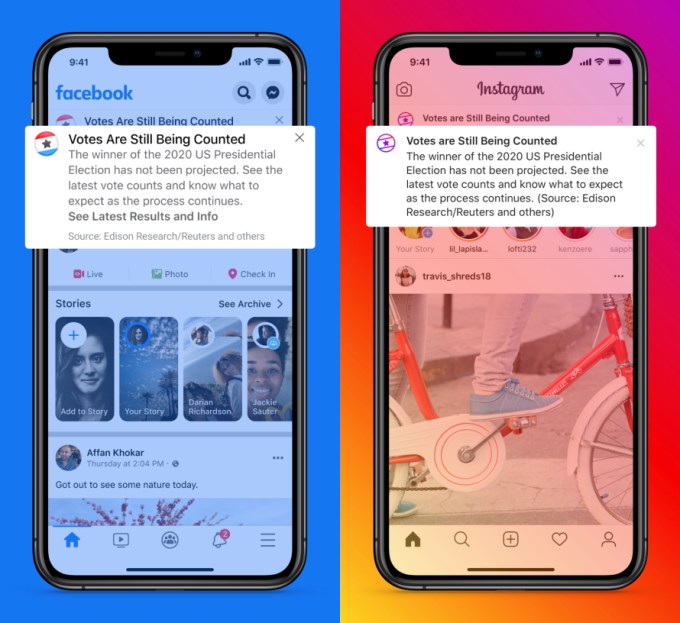

En la noche de las elecciones, Facebook colocará un mensaje en la parte superior de Facebook e Instagram para informar a los usuarios que el conteo de votos aún está en proceso. Cuando haya resultados autorizados, Facebook cambiará esos mensajes para reflejar los resultados oficiales. Es importante destacar que los resultados de las elecciones estadounidenses pueden no ser claros en la noche de las elecciones o durante algunos días después, un resultado potencial para el que Facebook y otras redes sociales se están preparando.

Imagen vía Facebook

Si un candidato declaró la victoria prematuramente, Facebook no dice que eliminará esas afirmaciones, pero las emparejará con su mensaje de que no hay un resultado oficial y la votación aún está en curso.

Gorjeo publicó sus planes para manejar los resultados de las elecciones hace dos meses, explicando que eliminará o colocará una etiqueta de advertencia a las afirmaciones prematuras de victoria antes de que se publiquen los resultados electorales autorizados. La compañía también declaró explícitamente que actuará contra cualquier tweet que “incite a una conducta ilegal para evitar una transferencia pacífica del poder o una sucesión ordenada ”, una regla impactante que tener que articular, pero necesaria en 2020.

El lunes, Twitter elaboró su política , diciendo que se centraría en etiquetar tweets engañosos sobre la elección presidencial y otras contiendas disputadas. La compañía publicó una imagen de muestra de una etiqueta que agregaría, mostrando una advertencia que indica que “este tweet está compartiendo información inexacta”.

La semana pasada, la compañía también comenzó a mostrar a los usuarios grandes advertencias de información errónea en la parte superior de sus feeds. Los mensajes les dijeron a los usuarios que “podrían encontrar información engañosa” sobre la votación por correo y también les advirtieron que los resultados de las elecciones podrían no conocerse de inmediato.

Según Twitter, los usuarios que intentan compartir tweets con información engañosa relacionada con las elecciones verán una ventana emergente que les indicará la información examinada y los obligará a hacer clic en una advertencia antes de compartir. Twitter también dice que actuará sobre cualquier “reclamo en disputa” que pueda arrojar dudas sobre la votación, incluida “información no verificada sobre manipulación electoral, manipulación de boletas electorales, recuento de votos o certificación de resultados electorales”.

Otro cambio importante que muchos usuarios probablemente ya notaron es la decisión de Twitter de deshabilitar los retweets . Los usuarios aún pueden retuitear haciendo clic en una página emergente, pero Twitter hizo el cambio para alentar a las personas a citar el retweet. El esfuerzo por frenar la difusión de información errónea fue sorprendente, y Twitter dijo que permanecerá en su lugar hasta el final de la semana de elecciones, al menos.

YouTube no entró en detalles similares sobre su toma de decisiones, pero la compañía dijo anteriormente que pondrá una etiqueta “informativa” en los resultados de búsqueda relacionados con las elecciones y debajo de los videos relacionados con las elecciones. La etiqueta advierte a los usuarios que “los resultados pueden no ser definitivos” y les indica el centro de información electoral de la empresa.

Desinformación extranjera

Esta es un área donde las redes sociales han logrado grandes avances. Después de que la desinformación rusa se arraigó en las plataformas sociales hace cuatro años , esas empresas ahora se coordinan entre sí y con el gobierno sobre las amenazas que están viendo.

A raíz de 2016, Facebook finalmente se dio cuenta de que su plataforma podría aprovecharse para escalar males sociales como el odio y la desinformación. Su cuadro de mando es desigual, pero sus acciones contra la desinformación extranjera han sido sólidas , reduciendo considerablemente esa amenaza.

Es poco probable que se repitan las mismas preocupaciones de 2016. Facebook hizo esfuerzos enérgicos para encontrar campañas de desinformación coordinadas en el extranjero en todas sus plataformas, y publica lo que encuentra con regularidad y con poca demora. Pero en 2020, las mayores preocupaciones provienen del interior del país, no sin él.

La mayoría de las operaciones de información en el extranjero han sido pequeñas hasta ahora, sin lograr mucha tracción. El mes pasado, Facebook eliminó una red de cuentas falsas conectadas a Irán. La operación fue pequeña y no logró generar mucha tracción, pero muestra que los adversarios estadounidenses todavía están interesados en probar la táctica.

Anuncios políticos engañosos

Para abordar las preocupaciones sobre la desinformación electoral en los anuncios, Facebook optó por un bloqueo temporal de los anuncios políticos, a partir de las 12 a.m. PT del 4 de noviembre y continuará hasta que la empresa considere que es seguro volver a activarlos. Facebook no ha aceptado ningún anuncio político nuevo desde el 27 de octubre y anteriormente dijo que no aceptará ningún anuncio que deslegitima los resultados de las elecciones. Google también detendrá los anuncios relacionados con las elecciones después del cierre de las urnas el martes.

Facebook ha realizado una serie de cambios importantes en los anuncios políticos desde 2016, cuando Rusia compró anuncios de Facebook para entrometerse en la política estadounidense. Los anuncios políticos en la plataforma están sujetos a más escrutinio y mucha más transparencia ahora y la biblioteca de anuncios de Facebook surgió como una herramienta ejemplar que permite a cualquiera ver qué anuncios se han publicado, quién los compró y cuánto gastaron.

A diferencia de Facebook, la forma en que Twitter se ocupaba de la publicidad política la cortaba por completo . La compañía anunció el cambio hace un año y no ha mirado atrás desde entonces. TikTok también optó por no permitir anuncios políticos .

La violencia política

La violencia por motivos políticos es una gran preocupación esta semana en los EE. UU., Una preocupación que muestra cuán tensa se ha vuelto la situación bajo los cuatro años de Trump. Antes del martes, el presidente ha hecho repetidas afirmaciones falsas de fraude electoral y ha alentado a sus seguidores a participar en la intimidación de los votantes, una amenaza de la que Facebook se dio cuenta lo suficiente como para hacer una política que prohíbe el lenguaje “militarizado” en torno a la observación de elecciones.

Facebook realizó una serie de otros cambios significativos recientes, como prohibir la peligrosa teoría de la conspiración pro-Trump QAnon y las milicias que usan la plataforma para organizarse , aunque esos esfuerzos han llegado muy tarde en el juego.

Facebook fue ampliamente criticado por su inacción en torno a una publicación de Trump que advierte “cuando comienza el saqueo, comienza el tiroteo” durante las protestas de justicia racial a principios de este año, pero su postura reciente sugiere que publicaciones similares podrían tomarse más en serio ahora. Estaremos observando cómo Facebook maneja las amenazas emergentes de violencia esta semana.

Sus recientes movimientos decisivos contra el extremismo son importantes, pero la plataforma ha incubado durante mucho tiempo a grupos que utilizan las herramientas de creación de redes y eventos de la compañía para unirse en busca de una posible violencia en el mundo real. Incluso si ya no se les permite en la plataforma, muchos de esos grupos se organizaron y luego trasladaron sus redes a redes sociales alternativas y canales privados. Aún así, hacer que sea más difícil organizar la violencia en las redes sociales convencionales es un gran paso en la dirección correcta.

Twitter también abordó de antemano la posible amenaza de violencia relacionada con las elecciones, señalando que puede agregar advertencias o requerir a los usuarios que eliminen cualquier tweet que “incite a intervenir en las elecciones” o fomente la violencia.

Cambios en la política de la plataforma en 2020

Facebook es el escenario en línea más grande donde se desarrolla la vida política de Estados Unidos. Si bien un número similar de estadounidenses ve videos en YouTube, Facebook es el lugar al que acuden para enfrentarse a los candidatos, compartir noticias (algunas legítimas, otras no) y, en general, expresarse políticamente. Es un polvorín en tiempos normales, y 2020 está lejos de ser normal.

Si bien Facebook actuó contra las amenazas extranjeras rápidamente después de 2016, la compañía se demoró en cambios de plataforma que podrían percibirse como motivados políticamente, una vacilación que resultó contraproducente al incubar a extremistas peligrosos y permitir que sobrevivieran muchos tipos de información errónea, particularmente en la extrema derecha. y prosperar.

A pesar de los persistentes temores políticos equivocados de Facebook , hay razones para tener la esperanza de que la empresa pueda evitar catástrofes relacionadas con las elecciones.

Ya sea que se inspiró en la amenaza de una elección impugnada, una acción federal antimonopolio o una posible presidencia de Biden, Facebook ha señalado un cambio hacia una moderación más reflexiva con una serie de decisiones recientes de aplicación de políticas. Una oleada de podcasts y anuncios televisivos centrados en las elecciones sugiere que Facebook también está preocupado por la percepción pública, y debería estarlo.

El plan de Twitter para las elecciones ha sido bien comunicado y detallado. En 2020, la empresa trata sus decisiones políticas con más transparencia, las comunica en tiempo real y no teme admitir errores. La red social relativamente pequeña juega un papel descomunal en la publicación de contenido político que se amplifica en otros lugares, por lo que las decisiones que toma son críticas para contrarrestar la desinformación y el extremismo.

Las empresas que albergan y amplifican la conversación política en línea han aprendido algunas lecciones importantes desde 2016, principalmente por las malas. Esperemos que sea suficiente para ayudarlos a guiar sus turbulentas plataformas a través de uno de los momentos más tensos de la historia moderna de los Estados Unidos.

Fuente: https://techcrunch.com/2020/11/02/2020-election-social-media-facebook-twitter-policies/